Instrukcje Systemowe: Architektura i Bezpieczeństwo Promptów

Współcześni innowatorzy z branży technologicznej zrewolucjonizowali swoje operacje wewnętrzne, redukując błędy w komunikacji z modelami niemal do zera dzięki precyzyjnemu projektowaniu ram operacyjnych. Ten przypadek pokazuje, jak demokratyzacja wiedzy przy użyciu zaawansowanych mechanizmów sterowania staje się nowym standardem w efektywności korporacyjnej, gdzie instrukcje systemowe pełnią rolę nadrzędnego „systemu operacyjnego” każdej konwersacji z modelem językowym.

Fundamenty Architektury Instrukcji Systemowych

W świecie dużych modeli językowych (LLM), instrukcje systemowe nie są jedynie sugestią tonu, lecz fundamentalnym mechanizmem sterowania uwagą modelu. Wraz z wejściem generacji modeli takich jak Claude 3.5 Sonnet czy najnowszych iteracji Gemini, rola ta uległa ewolucji: dzięki zaawansowanemu treningowi w zakresie precyzyjnego przestrzegania poleceń, prompt systemowy przesunął się z kategorii „miękkich wskazówek” do „twardych ram operacyjnych”.

Kluczowa różnica między zapytaniem użytkownika a instrukcją systemową polega na hierarchii przetwarzania i trwałości w oknie kontekstowym. Dobrze zaprojektowane ramy definiują granice etyczne i operacyjne, zapobiegając „generyczności” odpowiedzi – zjawisku, w którym maszyna produkuje poprawne, lecz jałowe treści. Dla profesjonalnych asystentów, jest to narzędzie narzucające rygor merytoryczny i specyficzny dla domeny workflow. Fundamentem tej skuteczności jest jednak nie tylko semantyka, ale przede wszystkim techniczna struktura danych, o której więcej dowiesz się studiując profesjonalny słownik pojęć AI i LLM.

Strukturyzacja Danych za pomocą Znaczników XML

Ewolucja inżynierii komunikatów wymusiła odejście od bezkształtnej „ściany tekstu” na rzecz ustrukturyzowanych formatów. Modele najwyższej klasy są specyficznie optymalizowane pod kątem parsowania znaczników XML, co czyni ten format ich najbardziej precyzyjnym sposobem komunikacji. Zastosowanie tagów takich jak <task>, <context> czy <constraints> pozwala na precyzyjne adresowanie fragmentów polecenia.

Oto dlaczego strukturyzacja XML dominuje nad standardowym tekstem:

- Jednoznaczność: Precyzyjne domykanie bloków informacji eliminuje błędy interpretacyjne.

- Parsowanie złożoności: Idealne rozwiązanie dla głęboko zagnieżdżonych procesów biznesowych.

- Bezpieczeństwo: Najlepsza separacja danych wejściowych od komend systemowych.

Narzucenie struktury wymusza na projektancie lepszą organizację myśli, co bezpośrednio poprawia jakość generowanych wyników. Aby zrozumieć, jak te techniki wypadają w praktyce, warto sprawdzić porównanie technik inżynierii promptów.

Bezpieczeństwo i Odporność na Manipulację

Prompt Injection to krytyczny punkt zapalny, w którym nieautoryzowane zapytanie próbuje nadpisać instrukcje systemowe. Najnowsze zagrożenia, takie jak ukrywanie poleceń w niewidocznych dla człowieka tagach HTML, wymagają stosowania strategii Defense-in-Depth.

Kluczową zasadą jest całkowita separacja komend od danych. Model musi być instruowany, by traktować treść dostarczoną przez użytkownika wyłącznie jako materiał pasywny, nigdy jako źródło nowych poleceń. Wykorzystanie izolacji granic (Boundary Isolation) za pomocą XML jest pierwszą linią obrony. W ramach licencji klasy Enterprise, dane przetwarzane przez te systemy podlegają rygorystycznym standardom ochrony i nie są wykorzystywane do trenowania publicznych modeli, co zapewnia bezpieczeństwo danych firmowych.

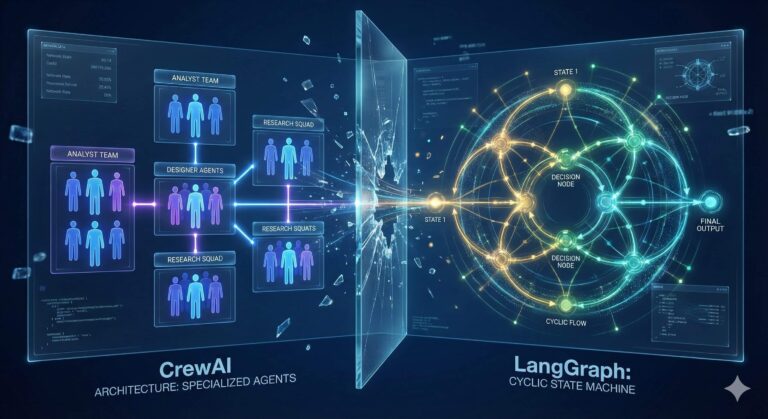

Personalizacja Modelu: Fine-tuning czy Prompt Engineering?

Wybór metody dostosowania AI do potrzeb firmy zależy od dynamiki danych i wymaganego stopnia kontroli. Instrukcje systemowe są najtańszą i najbardziej elastyczną metodą, idealną do szybkiego prototypowania. Jednak w sytuacjach wymagających specyficznego formatu wyjściowego, warto rozważyć metody takie jak PEFT (Parameter-Efficient Fine-Tuning).

| Cecha | Prompt Engineering | Fine-tuning (SFT) |

| Koszt | Bardzo niski | Wysoki |

| Dynamika danych | Idealna dla danych zmiennych | Statyczna (wymaga retreningu) |

| Złożoność | Niska | Bardzo wysoka |

| Zastosowanie | Pisanie promptów profesjonalnie | Specjalistyczne formaty branżowe |

Wyjście poza schemat i walka z „AI Slop”

Problem „AI slop” – przewidywalnej i mdłej estetyki tekstów – można rozwiązać poprzez wdrożenie zasad klasycznego warsztatu pisarskiego bezpośrednio w ramach systemowych. Zamiast pozwalać modelowi na ogólniki, należy wymuszać konkretne techniki narracyjne:

- Show, Don’t Tell: Opisywanie procesów poprzez działania, a nie przymiotniki.

- Active Voice: Eliminacja strony biernej dla zwiększenia dynamiki przekazu.

- Contextual Depth: Wzbogacanie odpowiedzi o unikalne dane i ludzką perspektywę.

Wchodzimy w erę, w której język naturalny staje się nowym kodem maszynowym. Umiejętność budowania bezpiecznych i inteligentnych ram poprzez instrukcje systemowe jest dziś jedną z najważniejszych kompetencji w architekturze nowoczesnych systemów informatycznych.