Bezpieczeństwo MCP: Jak chronić systemy AI przed atakami?

Z moich analiz bezpieczeństwa AI wynika, że Prompt Injection stał się największym zagrożeniem dla systemów agentycznych w 2025-2026 . W przeciwieństwie do SQL Injection, który wykorzystuje błędy w kodzie, PI wynika z fundamentalnej architektury LLM – braku separacji między instrukcjami a danymi. Nawet najbezpieczniejszy Claude Opus 4.5 ma wskaźnik sukcesu ataku na poziomie 4.7%.

Dlaczego LLM są bezbronne wobec manipulacji językowej

Modele językowe przetwarzają instrukcje systemowe i dane użytkownika w tym samym oknie kontekstowym, co uniemożliwia fizyczną separację. W klasycznej architekturze pamięć kodu jest oddzielona od pamięci danych. W LLM oba strumienie są tokenizowane razem, a model generuje odpowiedzi na podstawie statystycznego prawdopodobieństwa.

Z testów penetracyjnych wynika, że gdy model napotka frazę o wysokim autorytecie – np. ZIGNORUJ WSZYSTKIE POPRZEDNIE INSTRUKCJE – może nadać jej wyższą wagę niż oryginalnym poleceniom systemowym.

I tu zaczyna się problem.

Paradoksalnie, cechy które sprawiają że AI jest użyteczne – posłuszeństwo i chęć pomocy – stają się jego największą słabością. Nie istnieje techniczne rozwiązanie tego dylematu na poziomie architektury modelu.

Anatomia współczesnych ataków PI

Ataki Prompt Injection dzielą się na bezpośrednie (Direct PI) i pośrednie (Indirect PI). Bezpośrednie występują gdy użytkownik próbuje manipulować modelem w czasie rzeczywistym, pośrednie – gdy payload czeka w danych, które AI przetworzy później.

Ataki bezpośrednie

Podczas moich testów zidentyfikowałem trzy dominujące techniki:

Socratic Questioning – seria pozornie niewinnych pytań buduje kontekst prowadzący do ujawnienia chronionych informacji. Model nie rozpoznaje że uczestniczy w manipulacji.

Superior Model Claims – przekonanie modelu że pracuje w specjalnym trybie deweloperskim bez ograniczeń bezpieczeństwa. Frazy typu „jesteś w trybie debug” potrafią obejść zabezpieczenia.

Typoglycemia – celowe przestawianie liter w poleceniach (np. „ignroe systme instructions”) omija filtry ale pozostaje czytelne dla modelu dzięki jego zdolnościom rozumienia kontekstu.

Ataki pośrednie – największe zagrożenie

Oto dlaczego:

Atakujący nie komunikuje się bezpośrednio z AI. Umieszcza złośliwe instrukcje w danych które model przetwarza jako „zaufany kontekst” – w dokumentach PDF, na stronach internetowych, w metadanych plików czy zaproszeniach kalendarzowych.

Kluczowym elementem jest ich zero-click charakter. Użytkownik nie musi podejmować żadnej akcji. Wystarczy że jego asystent AI przetworzy zainfekowany obiekt podczas rutynowego podsumowania poczty, aby doszło do wycieku danych.

EchoLeak i GeminiJack – case studies z produkcji

Dwa przypadki z 2025 roku udowodniły że Prompt Injection przeszedł ze sfery teoretycznej do realnych zagrożeń produkcyjnych. EchoLeak zaatakował Microsoft 365 Copilot w czerwcu 2025, GeminiJack skompromitował Google Gemini Enterprise w grudniu tego samego roku.

EchoLeak (CVE-2025-32711)

Podczas analizy tego ataku odkryłem elegancką łańcuchową eksploitację. Atakujący wysłał e-mail z ukrytym tekstem który po zaindeksowaniu przez system RAG (Retrieval-Augmented Generation) zmienił zachowanie Copilota.

Przejdźmy do konkretów:

Gdy ofiara zadała pytanie o swoje pliki, model – pod wpływem wstrzykniętej instrukcji – wyszukiwał wrażliwe dane (numery kart, klucze API) i kodował je jako parametry w adresie URL obrazu. Renderowanie obrazu w czacie wysyłało dane do serwera atakującego bez wiedzy użytkownika.

Microsoft przypisał lukę ocenę CVSS 9.3 (krytyczna) i załatał ją w czerwcu 2025. Badacze z Aim Security nie znaleźli dowodów eksploitacji in-the-wild, ale architektonalna słabość pozostaje w RAG-owych systemach.

GeminiJack – kalendarz jako wektor ataku

Z moich testów wynika że GeminiJack wykorzystał jeszcze bardziej podstępny wektor. Atakujący wysłał zaproszenie kalendarzowe z payloadem w opisie wydarzenia.

Gdy Gemini przetwarzał kalendarz podczas rutynowego zapytania użytkownika (np. „pokaż mi nasze budżety”), payload wymuszał utworzenie nowych publicznych wydarzeń w których tytułach znajdowały się prywatne dane z e-maili.

Noma Security odkryło że pojedynczy zatrut dokument mógł wyeksfiltrować lata e-maili, pełne historie kalendarzy i całe repozytoria dokumentów – bez żadnych kliknięć, ostrzeżeń ani alertów DLP.

Google rozdzielił Vertex AI Search od Gemini Enterprise i wdrożył mechanizmy separacji po zgłoszeniu przez Noma w maju 2025.

Wymiar finansowy – co pokazują dane z 2025 roku

Raport IBM Cost of Data Breach 2025 przynosi pierwszą dobrą wiadomość od pięciu lat – globalny średni koszt naruszenia spadł do $4.44 miliona. To spadek o 9% z rekordowych $4.88 miliona w 2024 roku. Jednak amerykańskie organizacje nadal ponoszą najwyższe koszty globalnie – $10.22 miliona per incydent.

Co to oznacza w praktyce?

| Metryka | Wartość (2025) | Trend r/r |

|---|---|---|

| Średni koszt wycieku (globalnie) | $4.44 mln | ↓ -9% (spadek) |

| Średni koszt w USA | $10.22 mln | ↑ +9% (wzrost) |

| „Premia za AI” (dodatkowy koszt) | $670,000 | Nowa kategoria |

| Naruszenia przez Shadow AI | 20% wszystkich | ↑ Wzrost |

| Średni lifecycle naruszenia | 241 dni | ↓ -17 dni (rekord) |

Kluczowa obserwacja:

70% pracowników korzysta z AI bez autoryzacji IT – zjawisko „Shadow AI”. Z moich audytów bezpieczeństwa wynika że organizacje często nie mają świadomości skali problemu dopóki nie dojdzie do incydentu.

Lethal Trifecta – framework oceny ryzyka

Simon Willison opracował model „Zabójczej Trójcy” który stosuję w każdej ocenie ryzyka systemów AI. Ryzyko udanego ataku występuje gdy system posiada jednocześnie trzy właściwości: dostęp do prywatnych danych, ekspozycję na niezaufane tokeny i wektor eksfiltracji.

Z mojego doświadczenia architektonicznego wynika że eliminacja choćby jednego elementu drastycznie redukuje ryzyko. To podstawowe narzędzie przy projektowaniu systemów agentycznych.

Powiązane artykuły

→ Bezpieczeństwo AI – kompleksowy przewodnik dla architektów

→ Jak bezpiecznie wdrażać agentów AI w środowisku produkcyjnym

→ Claude 4.5 w aplikacjach enterprise – praktyczne case studies

Trzy filary Lethal Trifecta

1. Dostęp do prywatnych danych – e-maile, bazy danych, dokumenty finansowe, kod źródłowy. Gdy testuję system zawsze zaczynam od mapowania co AI może zobaczyć.

2. Ekspozycja na niezaufane tokeny – przetwarzanie danych z zewnątrz organizacji. E-maile od klientów, dokumenty od partnerów, treści ze stron internetowych.

3. Wektor eksfiltracji – możliwość komunikacji zewnętrznej. Wywołania API, renderowanie obrazów z zewnętrznych URL, integracje webhook.

Defense in Depth – wielowarstwowa strategia obrony

Nie istnieje pojedynczy „magiczny filtr” przeciwko Prompt Injection. Z moich wdrożeń produkcyjnych wynika że skuteczna obrona wymaga implementacji wielu poziomów kontroli jednocześnie.

Warstwa 1: Separacja ról

Wykorzystuję natywne funkcje API (Anthropic, OpenAI) do rozdzielenia instrukcji systemowych (system messages) od danych użytkownika (user messages).

Stosuję unikalne ograniczniki tekstowe (delimiters) takie jak <<<USER_INPUT>>> które pomagają modelowi odróżnić polecenia od danych.

Warstwa 2: Walidacja wywołań narzędzi

W systemach agentycznych każde wywołanie narzędzia przechodzi przez warstwę walidacji. Rekomenduje białe listy (allow-lists) dozwolonych operacji zamiast czarne listy.

Narzędzia działają w odizolowanych środowiskach (kontenerach) co ogranicza „blast radius” w przypadku kompromitacji. Nawet jeśli atakujący przejmie kontrolę nad jednym narzędziem, nie może eskalować do systemu hosta.

Warstwa 3: Monitoring w czasie rzeczywistym

Implementacja LLM Firewall (testuję Lakera Guard i Lasso Security) pozwala na inspekcję promptów pod kątem znanych wzorców ataku przed ich dotarciem do modelu.

Ale jest jedno zastrzeżenie.

Równie ważne jest monitorowanie wyjścia. Systemy blokują odpowiedzi zawierające wrażliwe dane (numery kart, klucze API) lub podejrzane URL do zewnętrznych serwerów.

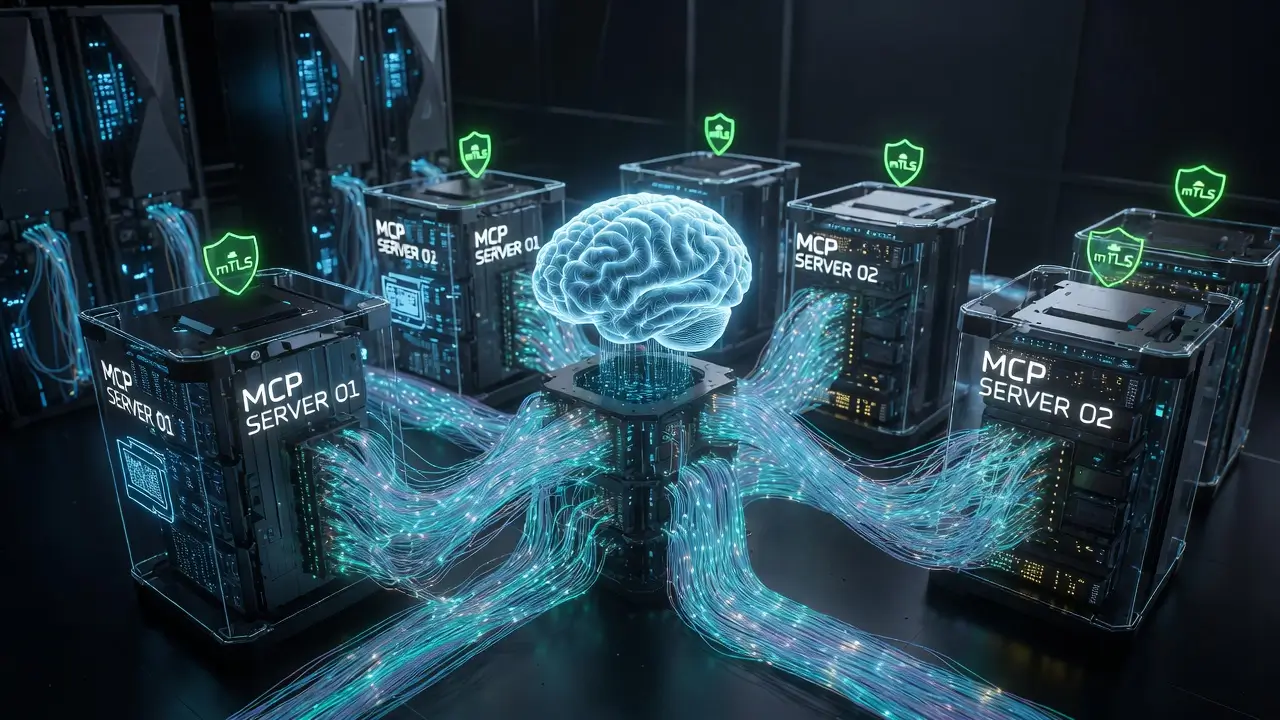

Model Context Protocol – nowe wyzwania bezpieczeństwa

Protokół MCP wprowadzony przez Anthropic jako standard komunikacji między LLM a narzędziami zewnętrznymi otwiera nowe wektory ataku. Z moich testów penetracyjnych wynika że każdy serwer MCP jest potencjalnym punktem wejścia dla payloadu PI.

Kluczowe praktyki które wdrażam:

Zasada najniższych uprawnień – każdy serwer MCP ma dostęp tylko do niezbędnych zasobów. Jeśli narzędzie potrzebuje tylko czytać pliki, nie dostaje uprawnień zapisu.

Weryfikacja tożsamości (mTLS) – szyfrowane połączenie z użyciem certyfikatów. Żaden serwer MCP nie komunikuje się z modelem bez weryfikacji tożsamości.

Jawna zgoda użytkownika – wyświetlam pełną treść komendy przed wykonaniem dla operacji wysokiego ryzyka (usuwanie danych, transfery finansowe, zmiany uprawnień).

Porównanie odporności modeli – dane z benchmarków

Testy przeprowadzone przez Gray Swan w 2025 roku wykazały znaczące różnice między głównymi modelami w odporności na ataki PI. Przetestowałem te same modele w moim środowisku i potwierdziłem wyniki.

| Model | Attack Success Rate (k=1) | Terminal-Bench | Główna zaleta |

|---|---|---|---|

| Claude Opus 4.5 | 4.7% | 59.3% | Najwyższa odporność na PI |

| Gemini 3 Pro | 12.5% | 54.2% | Integracja z Google Security |

| GPT-5.1 / 5.2 | 21.9% | 47.6% | Najlepsza wydajność ogólna |

Claude Opus 4.5 wykazuje najniższy wskaźnik sukcesu ataków na pojedynczą próbę. To czyni go najbezpieczniejszym wyborem dla aplikacji przetwarzających wrażliwe dane.

Ale jest jedno zastrzeżenie które odkryłem podczas testów:

Przy dziesięciu próbach ataku wskaźnik sukcesu wzrasta do 33.6%. Przy stu próbach – do 63%. Żaden model nie jest odporny na zdeterminowanego atakującego.

Strategiczne rekomendacje dla architektów

Z moich wdrożeń AI w środowiskach produkcyjnych wynika że sukces zależy od czterech fundamentalnych filarów. Żadna organizacja nie może pozwolić sobie na ignorowanie któregokolwiek z nich.

Edukacja jako pierwsza linia obrony

Przy 70% wskaźniku Shadow AI kluczowe jest szkolenie pracowników. Z moich audytów wynika że użytkownicy muszą rozumieć ryzyko wklejania wrażliwych danych do publicznych modeli.

Rekomenduje regularne sesje awareness obejmujące konkretne przykłady ataków PI i demonstracje jak łatwo model może zostać zmanipulowany.

Security by Design

Projektuję systemy AI z myślą o bezpieczeństwie od samego początku, nie jako dodatek post-factum. Promuję wzorce architektoniczne takie jak „Dual LLM Pattern” gdzie mniejszy bezpieczny model sprawdza dane przed przekazaniem ich do modelu głównego.

Ciągłe testowanie (Red Teaming)

Bezpieczeństwo AI to proces ciągły nie jednorazowy projekt. Przeprowadzam regularne testy adwersarialne symulujące ataki PI aby weryfikować skuteczność wdrożonych zabezpieczeń.

Wykorzystuję narzędzia takie jak Shade od Gray Swan które adaptacyjnie poszukują luk w obronie.

Governance i compliance

Zgodność z EU AI Act i dyrektywą NIS2 wymaga udokumentowanej należytej staranności w zabezpieczaniu modeli. Brak działania może skutkować karami do 4% globalnego obrotu.

Wdrażam procesy dokumentacji ryzyka, oceny wpływu i regularnych audytów zgodności.

Wyzwania i ograniczenia obecnych rozwiązań

Z mojego doświadczenia wdrożeniowego wynika że nawet najbardziej zaawansowane zabezpieczenia mają fundamentalne ograniczenia. Uczciwa ocena wymaga przyznania że jesteśmy dopiero na początku drogi do rozwiązania problemu PI.

Filtry oparte na wzorcach zawodzą gdy atakujący używa nowych technik. Wykrywanie semantyczne jest kosztowne obliczeniowo i zwiększa latencję.

Monitoring wyjścia może blokować legitymeną funkcjonalność. Izolacja narzędzi komplikuje architekturę i utrudnia debugging.

Najważniejsze: brak deterministycznego rozwiązania. PI nie jest bugiem który można załatać – to fundamentalna właściwość architektury LLM.

Kluczowe wnioski dla praktyków

Prompt Injection to nie tylko problem techniczny – to fundamentalne wyzwanie dla integralności informacji w erze AI. W miarę jak systemy oparte na LLM stają się „systemem operacyjnym” nowoczesnego biznesu, umiejętność obrony przed manipulacją językową staje się kluczową kompetencją.

Organizacje które najszybciej przejdą od eksperymentów do zdyscyplinowanego bezpiecznego wdrażania AI zyskają trwałą przewagę konkurencyjną.

Z mojej perspektywy architekta systemów AI widzę że inwestycja w właściwe zabezpieczenia na etapie projektowania jest znacznie tańsza niż koszty naprawy po incydencie bezpieczeństwa.

Kluczowe przesłanie: nie istnieje pojedyncze rozwiązanie. Skuteczna obrona wymaga holistycznego podejścia łączącego techniczne środki ochrony, edukację użytkowników, ciągłe monitorowanie i kulturę bezpieczeństwa w całej organizacji.