Moltbot pod lupą: Dlaczego ta automatyzacja to ryzyko krytyczne dla Twojej firmy?

Współczesna automatyzacja procesów biznesowych (programmatic automation) oparta na modelach językowych (LLM) obiecuje skokową poprawę wydajności, jednak z perspektywy bezpieczeństwa systemów krytycznych wprowadza ryzyka o charakterze egzystencjalnym dla integralności danych. Niniejszy raport stanowi analizę narzędzia Moltbot (dawniej Clawdbot) pod kątem jego dopuszczenia do użytku w środowisku firmowym.

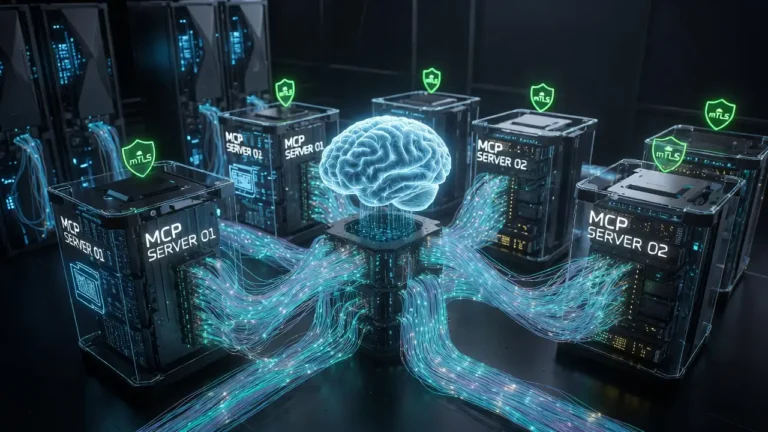

Z punktu widzenia architektonicznego, Moltbot promuje model „wszystko ze wszystkim”, który w sposób niekontrolowany zaciera granice między kanałami komunikacji zewnętrznej a wewnętrzną warstwą kontrolną systemu operacyjnego. Niniejsze opracowanie wykazuje, że obecna implementacja tego rozwiązania stanowi rażące naruszenie podstawowych zasad higieny cybernetycznej i stwarza wektor ataku typu unauthenticated Remote Code Execution (RCE) na stacjach roboczych pracowników. Przed przystąpieniem do szczegółowej analizy podatności konieczna jest dekompozycja architektury rozwiązania, która ujawnia fundamentalne błędy projektowe.

Architektura i Funkcjonalność Systemu Moltbot

Architektura Moltbot redefiniuje interakcję człowiek-maszyna, czyniąc z modelu LLM centralnego pośrednika (agent), który dysponuje szerokimi uprawnieniami wykonawczymi w systemie lokalnym. Model operacyjny narzędzia opiera się na następujących komponentach:

- Agregacja Kanałów Komunikacji: Natywna integracja z platformami WhatsApp, Telegram, Signal oraz Discord, które służą jako kanały wejściowe dla instrukcji (prompts).

- Integracja z Narzędziami Produktywnymi (Google Workspace): Wykorzystanie narzędzi takich jak GOG CLI do interakcji z Gmail i kalendarzem. Należy podkreślić, że dostęp do GOG CLI oznacza potencjalną kompromitację całego ekosystemu Google Workspace, a nie tylko pojedynczej skrzynki pocztowej.

- Lokalne Środowisko Uruchomieniowe: Aplikacja działa na

localhost, co w założeniu twórców ma izolować dane. W rzeczywistości jednak brak mechanizmów kontroli sprawia, że Moltbot operuje z pełnymi uprawnieniami użytkownika lokalnego (Full System Access), co drastycznie zwiększa powierzchnię ataku.

Poniższe zestawienie konfrontuje deklarowane cele biznesowe z techniczną rzeczywistością audytowanego systemu:

| Deklarowane Cele Automatyzacji | Techniczna Rzeczywistość |

| Inteligentne streszczanie i zarządzanie komunikacją | Całkowity brak separacji między niezaufanymi danymi zewnętrznymi a instrukcjami systemowymi. |

| Wysoka wydajność dzięki integracji SaaS | Aplikacja posiada uprawnienia Read/Write do całego katalogu domowego użytkownika i możliwość wykonywania dowolnych komend. |

| Centralne zarządzanie konfiguracją | Brak mechanizmów bezpiecznego składowania (vaulting); poświadczenia wystawione na kompromitację lokalną. |

| Pełna automatyzacja działań (np. rezerwacje) | Brak granulacji uprawnień (Least Privilege); jedna podatność skutkuje całkowitą utratą kontroli nad tożsamością cyfrową. |

Kluczowym elementem analizy, decydującym o krytycznej ocenie systemu, jest sposób zarządzania poświadczeniami.

Analiza Zarządzania Poświadczeniami i Kluczami API

Zasada bezpiecznego przechowywania kluczy API i tokenów uwierzytelniających (Secrets Management) jest fundamentem bezpieczeństwa korporacyjnego. Naruszenie tej zasady w systemie o tak szerokim dostępie jak Moltbot generuje ryzyko o gigantycznym zasięgu (blast radius).

Podczas audytu Moltbot zidentyfikowano następujące naruszenia:

- Przechowywanie w tekście jawnym (Plaintext): Wszystkie klucze API (OpenAI, Anthropic, Slack, Gmail) są składowane na dysku w formie niezaszyfrowanej. W przypadku infekcji malware lub nieautoryzowanego dostępu do plików, napastnik uzyskuje natychmiastowy dostęp do wszystkich zintegrowanych usług SaaS.

- Ekspozycja w „Security Gateway”: Interfejs konfiguracyjny (front page) aplikacji, zamiast chronić poświadczenia, wyświetla wszystkie aktywne klucze API w formie jawnej bezpośrednio w przeglądarce. Nie jest to błąd implementacji, lecz świadoma cecha projektowa (feature), co świadczy o braku uwzględnienia bezpiecznego cyklu wytwarzania oprogramowania (SDLC).

Implikacje strategiczne: Kompromitacja lokalnej sesji oznacza natychmiastowy „Credential Harvesting”. Ponieważ klucze do LLM (np. OpenAI) często mają włączone automatyczne doładowania (auto-billing), przejęcie ich skutkuje nie tylko wyciekiem danych, ale również bezpośrednimi stratami finansowymi organizacji. Brak wewnętrznej segmentacji ról potęguje to zagrożenie.

Brak Segmentacji Uprawnień i Ryzyko Kompromitacji Systemowej

Wdrożenie Moltbot w obecnej architekturze stanowi zaprzeczenie zasady najmniejszych uprawnień (Least Privilege). System nie posiada mechanizmów izolacji procesów ani ról.

- Model Pojedynczego Użytkownika: System operuje jako monolit. Jeśli agent otrzyma uprawnienia do obsługi poczty, automatycznie posiada te same uprawnienia do modyfikacji plików systemowych i wykonywania skryptów.

- Lateral Movement i Full System Access: Narzędzie dysponuje prawami Read/Write do systemu plików. W praktyce oznacza to, że jeden punkt kompromitacji (np. zainfekowany bot na Discordzie) umożliwia napastnikowi poruszanie się po całej infrastrukturze dostępnej z poziomu stacji roboczej pracownika.

Zagrożenie to nie jest teoretyczne – staje się bezpośrednio wykonalne poprzez najbardziej niebezpieczną podatność systemów AI: Prompt Injection.

Podatność na Ataki Typu Prompt Injection w Kanałach Automatyzacji

W klasycznej informatyce walka z podatnościami takimi jak SQL Injection nauczyła nas oddzielać dane (User Plane) od komend sterujących (Control Plane). Moltbot cofa bezpieczeństwo IT o dwie dekady, zacierając tę różnicę.

Mechanizm ataku i wektory kompromitacji: W systemie Moltbot każda przychodząca wiadomość e-mail lub powiadomienie z komunikatora staje się wektorem ataku. Ponieważ model LLM nie potrafi skutecznie odróżnić treści wiadomości od instrukcji systemowych (brak „firewallingu”), dane zewnętrzne stają się kodem wykonywalnym.

- Scenariusz Krytyczny: Napastnik może wysłać e-mail, który zmusi agenta Moltbot do odczytania pliku z kluczami API (przechowywanymi w plaintext) i wysłania ich na serwer zewnętrzny (Exfiltration). To połączenie dwóch wad projektowych – jawnych kluczy i braku izolacji warstwy kontrolnej – czyni z Moltbota horror bezpieczeństwa.

Obecne modele LLM nie posiadają mechanizmów odpornych na Prompt Injection, co przy pełnym dostępie do systemu czyni automatyzację Moltbot skrajnie niebezpieczną.

Synteza Ryzyk i Rekomendacje dla Decydentów IT

Na podstawie przeprowadzonego audytu poziom ryzyka wdrożenia Moltbot w infrastrukturze korporacyjnej oceniam jako KRYTYCZNY.

Kluczowe argumenty przeciwko dopuszczeniu narzędzia:

- Rażące naruszenie standardów ochrony danych: Klucze API składowane w plaintext i wystawione w interfejsie graficznym.

- Brak izolacji procesów: Aplikacja operuje w modelu „wszystko ze wszystkim”, co przy kompromitacji jednego kanału daje pełny dostęp do systemu operacyjnego i konta Google Workspace.

- Nieobliczalność wejścia i brak provenance: Każdy podmiot zewnętrzny może wykonać dowolny kod na maszynie pracownika za pomocą e-maila (Prompt Injection). To ekwiwalent dopuszczenia unauthenticated RCE do wnętrza sieci.

Rekomendacja Końcowa

Zalecam bezwzględny zakaz stosowania narzędzia Moltbot w obecnej formie. Brak możliwości technicznej weryfikacji pochodzenia instrukcji w architekturze opartej na LLM uniemożliwia implementację skutecznych filtrów bezpieczeństwa.

Ewentualne testy mogą być prowadzone wyłącznie w całkowicie izolowanym środowisku typu sandbox (air-gap), na maszynach bez dostępu do danych firmowych, sieci lokalnej oraz bez podpiętych kart płatniczych pod API. W procesie transformacji cyfrowej bezpieczeństwo zasobów i ochrona tożsamości muszą mieć absolutny priorytet nad doraźną wygodą automatyzacji.

Moltbot (dawniej Clawdbot) to oparte na modelach językowych (LLM) narzędzie do automatyzacji procesów biznesowych, które natywnie integruje się z popularnymi komunikatorami (WhatsApp, Signal, Discord) oraz pakietem Google Workspace. Aplikacja działa na środowisku localhost i wykorzystuje sztuczną inteligencję jako centralnego agenta wykonawczego do zarządzania komunikacją i zadaniami. Niestety, ze względu na architekturę promującą model „wszystko ze wszystkim” oraz brak izolacji procesów, narzędzie to wprowadza krytyczne ryzyka dla higieny cybernetycznej. Zamiast optymalizować pracę, tworzy wektory ataków na stacje robocze, co dyskwalifikuje je z użytku korporacyjnego.

Zarządzanie kluczami API w architekturze Moltbot opiera się na przechowywaniu poświadczeń w tekście jawnym (plaintext) na lokalnym dysku, co stanowi rażące naruszenie korporacyjnych standardów bezpieczeństwa. System całkowicie ignoruje mechanizmy bezpiecznego składowania (vaulting), a wszystkie aktywne klucze (np. do OpenAI, Slack, Gmail) są dodatkowo eksponowane w niezabezpieczonym interfejsie graficznym. W przypadku najdrobniejszej infekcji stacji roboczej, napastnik uzyskuje natychmiastowy dostęp do wszystkich zintegrowanych usług SaaS, co grozi masowym wyciekiem danych oraz bezpośrednimi stratami finansowymi z podpiętych pod API kart płatniczych.

Podatność Prompt Injection w architekturze Moltbot umożliwia atakującemu zdalne wykonanie kodu (RCE) na komputerze ofiary poprzez wysłanie złośliwie spreparowanej wiadomości e-mail lub komunikatu na czacie. Ponieważ model LLM w tym systemie nie posiada firewalla i nie potrafi odróżnić niezaufanych danych zewnętrznych od systemowych instrukcji sterujących, traktuje przychodzące wiadomości jako kod wykonywalny. W krytycznym scenariuszu napastnik może w ten sposób zmusić agenta do odczytania jawnie zapisanych kluczy API i wyeksfiltrowania ich na zewnętrzny serwer.

Zasadnicza różnica w architekturze polega na całkowitym zignorowaniu zasady najmniejszych uprawnień (Least Privilege) w systemie Moltbot, w przeciwieństwie do klasycznych, bezpiecznych rozwiązań IT. Tradycyjne oprogramowanie ściśle izoluje dane wprowadzane przez użytkownika (User Plane) od komend sterujących (Control Plane). Moltbot operuje jako monolit z pełnymi uprawnieniami (Full System Access) do katalogu domowego. Oznacza to, że kompromitacja zaledwie jednego, najsłabszego kanału (np. bota na Discordzie) automatycznie otwiera drogę do przejęcia całego systemu operacyjnego oraz środowiska Google Workspace.

Z powodu krytycznych błędów projektowych, wdrożenie Moltbot w produkcyjnym środowisku firmowym powinno być bezwzględnie zakazane na każdym etapie. Narzędzie to nie daje możliwości technicznej weryfikacji pochodzenia instrukcji, co uniemożliwia skuteczne filtrowanie zagrożeń. Ewentualne testy i eksperymenty z tym rozwiązaniem mogą być prowadzone wyłącznie w całkowicie izolowanym środowisku typu sandbox (air-gap). Taka maszyna badawcza musi być fizycznie odłączona od sieci lokalnej, pozbawiona jakiegokolwiek dostępu do danych firmowych oraz nie może posiadać podpiętych form płatności.